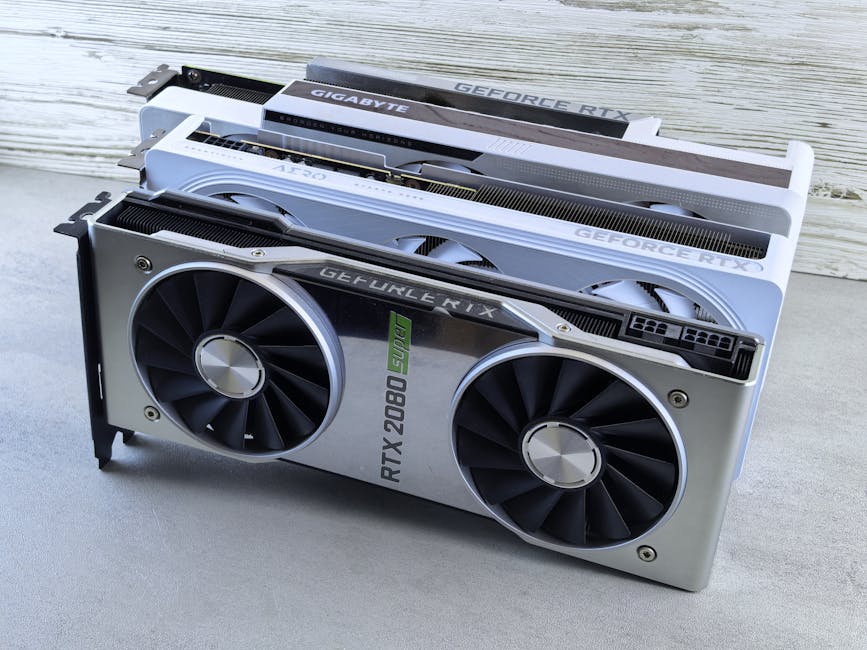

AI 작업, ‘메모리 부족’ 스트레스는 이제 그만? RTX 4060 Ti 16GB 체험기

안녕하세요, AI 도구와 디지털 생산성에 진심인 블로거입니다. AI 이미지 생성, 복잡한 모델 학습, 대규모 LLM(거대 언어 모델) 구동… 이 모든 과정에서 겪는 가장 큰 스트레스는 바로 ‘메모리 부족(Out of Memory)’ 에러가 아닐까 싶어요. 저렴한 GPU를 찾다 보면 항상 VRAM 용량에 발목 잡혀 아쉬웠던 경험, 다들 있으실 겁니다. 엔비디아의 RTX 4060 Ti 16GB 모델이 출시되었을 때, 저는 “드디어 합리적인 가격에 충분한 VRAM을 가진 카드가 나왔구나!” 하며 큰 기대를 했죠. 하지만 과연 이 카드가 AI 파워 유저의 기대를 충족시켜줄까요? 제가 직접 사용해보며 느낀 솔직한 후기를 지금부터 들려드릴게요.

RTX 4060 Ti 16GB 핵심 스펙 한눈에 보기

| 항목 | 세부 정보 |

|---|---|

| GPU 아키텍처 | Ada Lovelace |

| VRAM | 16GB GDDR6 |

| CUDA 코어 | 4352 |

| 메모리 인터페이스 | 128-bit |

| 메모리 대역폭 | 288 GB/s |

| TDP | 160W |

| 권장 소비자 가격 (약) | $499 USD |

직접 써보니 이런 점이 좋았고, 이런 점은 아쉬웠어요 (장단점 분석)

👍 장점

- 넉넉한 16GB VRAM: 이 가격대에서 16GB VRAM은 압도적입니다. 고해상도 AI 이미지 생성, 대규모 배치 처리, 복잡한 ControlNet 모델 구동 시 ‘메모리 부족’ 걱정을 크게 덜어줍니다.

- 낮은 전력 소비량: 160W의 낮은 TDP 덕분에 전원 공급 장치 부담이 적고, 발열 관리에도 유리합니다.

- 준수한 게이밍 성능: AI 작업뿐만 아니라 게이밍 성능도 가격대비 훌륭하여, 다방면으로 활용하기 좋습니다.

- 강력한 CUDA 생태계: 엔비디아의 CUDA는 AI 개발의 표준이죠. 안정적이고 다양한 라이브러리 지원은 언제나 큰 장점입니다.

👎 단점 (솔직한 비판적 관점)

- 치명적인 128-bit 메모리 버스: 가장 아쉬운 부분입니다. 16GB의 VRAM을 가득 채우더라도, 좁은 메모리 대역폭(288 GB/s) 때문에 데이터 전송 속도가 발목을 잡습니다. 특히 AI 작업 중 높은 대역폭을 요구하는 경우, VRAM 용량만큼의 속도 향상을 기대하기 어렵습니다.

- AI 작업 시 가성비 논란: 순수 컴퓨팅 성능만 놓고 보면, 일부 구세대 상위 카드(예: 중고 3090)나 현세대 상위 카드에 비해 가격 대비 성능이 아쉬울 수 있습니다. VRAM이 중요한 특정 작업 외에는 뚜렷한 이점을 체감하기 어려울 때도 있어요.

- Stable Diffusion 생성 속도: 고해상도 이미지를 ‘생성’하는 데는 VRAM 덕분에 유리하지만, ‘속도’ 자체는 오히려 VRAM은 적어도 메모리 버스가 넓은 다른 카드(예: 3070 Ti)에 비해 밀릴 때도 있습니다. 용량과 속도 사이의 딜레마죠.

- 대규모 모델 학습에는 한계: VRAM이 충분하여 배치 사이즈를 늘릴 수 있지만, CUDA 코어 수와 메모리 대역폭의 한계로 인해 대규모 파운데이션 모델 학습이나 복잡한 연구 개발용으로는 적합하지 않습니다.

AI 퍼포먼스 딥 다이브: 실제 사용해보니 이랬습니다

RTX 4060 Ti 16GB를 처음 사용하면서 든 생각은 “드디어 예산 내에서 VRAM 걱정 없이 AI 작업을 할 수 있겠구나!” 였습니다. 그리고 어느 정도는 그 약속을 지켜줬다고 생각해요。

Stable Diffusion 작업에서 16GB VRAM은 정말 빛을 발합니다. 1024×1024 같은 고해상도 이미지를 안정적으로 생성하고, 배치 사이즈를 늘려 여러 이미지를 한 번에 뽑아낼 수 있었죠. 복잡한 ControlNet 모델을 여러 개 동시에 적용해도 ‘메모리 부족’ 에러 없이 잘 돌아갔습니다. 이 부분은 정말 압도적인 장점이에요。

하지만 한 가지 중요한 사실을 발견했습니다. 16GB VRAM 덕분에 ‘용량’은 충분했지만, ‘생성 속도’는 기대만큼 빠르지 않다는 점이었죠. 128-bit 메모리 버스가 발목을 잡는다는 느낌을 강하게 받았습니다. 예를 들어, 512×512 이미지 생성 시 3060 12GB와 비교하여 드라마틱한 속도 차이를 느끼기 어려웠고, 고해상도 작업에서는 4070이나 3080이 훨씬 빠르게 처리했습니다. 용량은 채워주지만, 처리 속도는 여전히 아쉽다는 평이 나올 수밖에 없는 이유입니다.

LLM(거대 언어 모델) 추론에서는 의외의 강점을 보여줬습니다. 16GB VRAM 덕분에 Llama 2, Mistral 같은 7B, 13B 모델들을 FP16 또는 Q8_0 양자화 상태로 무리 없이 로드하고 실행할 수 있었어요. 토큰 생성 속도도 개인 사용이나 소규모 개발 프로젝트에는 충분히 만족스러웠습니다. 이제 더 이상 작은 양자화 모델에만 갇혀 있을 필요가 없습니다.

Python 트레이닝 (PyTorch/TensorFlow)의 경우, 입문 단계의 실험이나 작은 모델(예: Stable Diffusion LoRA 파인튜닝, 소규모 CNN) 학습에는 16GB VRAM 덕분에 더 큰 배치 사이즈를 사용할 수 있다는 큰 이점이 있습니다. 하지만 대규모 파운데이션 모델을 처음부터 학습하거나 복잡한 연구 개발에는 CUDA 코어 수와 메모리 대역폭의 한계가 명확하게 드러납니다. ‘시작점’으로는 좋지만, ‘작업마’는 아니라고 할 수 있겠네요。

그래서, RTX 4060 Ti 16GB 누가 사야 할까? (솔직한 최종 결론)

이쯤 되면 고민되실 겁니다. 과연 RTX 4060 Ti 16GB는 나에게 맞는 카드일까?

✅ 이 카드를 강력 추천합니다!

- AI 취미 사용자나 콘텐츠 크리에이터: Stable Diffusion 등 AI 이미지 생성에서 ‘메모리 부족’ 때문에 고통받고 계셨던 분들, 고해상도 이미지, 복잡한 ControlNet, 대규모 배치 처리가 필수적인 분들께는 최고의 선택지입니다. 게이밍은 부가적인 요소라고 생각하신다면 더욱 만족하실 겁니다.

- 로컬 LLM 구동이 목표인 분: 7B~13B급 LLM 모델을 개인적으로 사용하거나 소규모 개발 프로젝트에 활용하고 싶은 분들께 16GB VRAM은 매우 유용합니다.

- 예산 제약 속에서 최대 VRAM이 필요한 분: 예산은 한정되어 있지만, 새로운 GPU 중 VRAM 용량이 가장 중요한 고려사항이라면, 메모리 버스의 한계를 인지하고도 이 카드를 선택할 수 있습니다.

- 현재 사용 중인 GPU가 VRAM 한계에 자주 부딪히는 분들.

❌ 이 카드는 한 번 더 고민해보세요!

- 진지한 AI 연구자 또는 전문 개발자: 모델 학습의 절대적인 컴퓨팅 파워와 대역폭이 가장 중요한 분이라면, 4070 Super/4070 Ti Super 또는 중고 3090 같은 상위 카드가 훨씬 더 나은 가치를 제공할 수 있습니다. (물론 전력 소모는 더 크겠죠.)

- VRAM 용량보다 Stable Diffusion ‘생성 속도’를 최우선으로 하는 분: VRAM 한계에 자주 부딪히지 않고, 오직 이미지 생성 속도만을 원한다면 다른 선택지가 더 효율적일 수 있습니다.

- VRAM 용량보다 순수 게이밍 성능이 최우선인 분: 순수 게이밍 성능만 놓고 보면, 비슷한 가격대의 다른 카드들이 더 좋은 프레임을 제공할 수 있습니다.

- 3060 12GB와 비교하여 VRAM 용량 이외에 드라마틱한 AI 성능 향상을 기대하는 분.

결론적으로, RTX 4060 Ti 16GB는 ‘VRAM 용량’이라는 AI 작업의 고질적인 문제를 합리적인 가격에 해결해주는 매력적인 카드입니다. 하지만 128-bit 메모리 버스라는 ‘속도’ 측면의 한계 또한 분명합니다. 자신의 AI 워크로드와 우선순위를 명확히 파악하고 선택한다면, 이 카드는 분명 당신의 AI 여정에 큰 도움이 될 것입니다. 제 솔직한 후기가 여러분의 현명한 선택에 도움이 되기를 바랍니다。

🏆 에디터 추천 픽

NVIDIA GeForce RTX 4060 Ti 16GB

AI 작업에 최적화된 최고의 가성비 모델

* Affiliate disclaimer: We may earn a commission from purchases.

#RTX 4060 Ti 16GB #AI 그림 #Stable Diffusion #LLM #GPU 추천 #그래픽카드 #엔비디아